По материалам доклада организации «Human Rights Watch» о полностью автономном оружии («роботах-убийцах»)

Введение

По мере быстрого развития и быстрого увеличения количества автоматизированного оружия, оружие начинает на поле боя брать на себя некоторые функции солдат. Эксперты в областях вооружений и робототехники предсказывают, что в течение 20-30 лет может быть разработано полностью автономное оружие (или «роботы-убийцы»), которое сможет выбирать и поражать цели по своему усмотрению без человеческого вмешательства. В настоящее время военные официальные лица говорят, что люди пока ещё сохраняют возможность выбора при принятии решения: использовать (по умолчанию — смертельное) оружие или нет. Но, однажды, роботы смогут делать этот выбор по своему усмотрению.

Данный доклад был подготовлен негосударственными организациями «Human Rights Watch» (переводится как «наблюдение за правами человека») и «International Human Rights Clinic» (переводится как «интернациональная клиника гуманитарных прав», подразделение Гарвардской школы права). Первоочередной задачей этих организаций является: оценить, какое влияние полностью автономное оружие оказало бы на гарантии защиты мирного населения во времена войны.

Этот отчет анализирует: выполняли бы «роботы-убийцы» требования международного гуманитарного право и давали ли бы они возможность проверять факты убийства гражданских лиц на соответствие нормам международного гуманитарного права.

Похоже, что полностью автономное оружие не только будет неспособно соответствовать юридическим стандартам, но также подорвет существенные неюридические гарантии безопасности для гражданских лиц. Авторы доклада приходят к заключению, что полностью автономное оружие не будет совместимо с международным гуманитарным правом. Его применение существенно увеличит риск гибели или ранения мирных жителей во время вооруженного конфликта. Поэтому, необходим запрет на разработку, изготовление и использование такого оружия. И правительства всех стран должны срочно добиваться этого.

Полностью автономного оружия, которому уделяется основное внимание в этом отчете, еще не существует, но соответствующая технология развивается. И предшественники роботов-убийц уже используются. Многие страны используют системы оборонительного оружия, которые запрограммированы так, чтобы автоматически уничтожать воздушные цели. Другие предшественники полностью автономного оружия (использующиеся или находящиеся в разработке), предназначены для уничтожения живой силы и могут быть мобильным оружием нападения. Вооруженные силы дают высокую оценку такому оружию, потому что оно снижает риск поражения собственных солдат. Примеры, описанные в этом докладе, показывают, что много стран, и прежде всего США, близки к созданию роботов-убийц и имеют большой интерес к достижению этой цели.

Классификация оружия по степени автономности

Автоматизированное оружие, которое является «беспилотным», т.е., управляется удалённо оператором, часто делится на 3 категории по степени человеческого участия в его действиях:

• Человек В системе управления оружием (условно, IN). Роботы применяют оружие только после человеческой команды.

• Человек НА системе управления оружием (условно, ON): Роботы выбирают цели и применяют оружие самостоятельно, но под наблюдением человека, который может отменить действий робота.

• Человек ВНЕ системы управления оружием (условно, OUT): Роботы выбирают цели и применяют оружие самостоятельно, без какого-либо человеческого участия. Человек не может отменить действий робота.

Примечания: В этом отчете термины «робот» и «роботизированное оружие» охватывают все 3 типа автоматизированного оружия. Другими словами — всё, начиная от беспилотных самолетов с дистанционным управлением и заканчивая полностью автономным оружием — «роботами убийцами». Хотя эксперты обсуждают точное определение, что такое робот, по существу роботы – это машины, которые работают на основании того, как они запрограммированы. Некоторые роботы обладают определенной степенью автономии, что означает способность машины работать без человеческого наблюдения/участия. Уровень автономии робота может измениться в очень широких пределах. Данная классификация и тенденция в развитии оружия являются прекрасным примером для ТРИЗ (теория решения изобретательских задач) на линию развития «вытеснение человека из технической системы».

1. Планы развития автономного оружия

Использование роботов в боевых действиях – уже не новость. Американские «дроны» (беспилотные самолёты удалённо управляемые оператором) Predator, Reaper широко использовались в Афганистане и других странах. Эти дроны уже обладают некоторым уровнем автономии, которая относится к способности машины работать без человеческого наблюдения. Дроны обеспечивают разведку и обнаруживают цели, а оператор идентифицирует цель, принимает решение и подаёт дрону команду на применение оружия, что соответствует степени автономности IN (Человек В системе управления оружием). Таким образом, у нынешнего автоматизированного оружия в «петле принятия решения» (decision loop) все еще есть человек, т.е., требуется человеческое вмешательство прежде, чем будет применено оружие. Если бы оружие было полностью автономно, то оно идентифицировало бы цели и само их уничтожало.

Поскольку наблюдается тенденция вытеснения человека из «цепи принятия решения», в скором времени полностью автономное оружие («роботы-убийцы») будет само принимать решение о применении оружия. По мнению военных экспертов, вооруженные воздушные силы будущего будут все более и более беспилотными и автономными. В последнее время Министерство обороны США ежегодно тратит примерно $ 6 млрд. на научные исследования в этой области. Военные стратегические документы, особенно США, отражают планы увеличения степени автономности систем вооружений. Министерство обороны США предполагает развитие беспилотных воздушных, наземных и подводных систем, легко совместимых с системами, управляемыми человеком, постепенное уменьшение степени человеческого контроля и принятия решения. По оценкам экспертов, полностью автономное оружие будет на вооружении к 2025 г.

2. Предшественники полностью автономного оружия.

2.1. Системы автоматического оборонительного оружия

Системы автоматического оборонительного оружия являются первым шагом на пути к полной автономии оружия. Данные системы обнаруживают воздушные цели и автоматически применяют свои средства поражения, чтобы их обезвредить. Человеческое участие в работе системы здесь ограничено принятием или отвержением плана действий компьютера за несколько секунд до применения средств поражения.

У США есть несколько таких систем. Автоматизированная корабельная система ближнего боя «Фаланга» была установлена на боевые корабли ещё в 1980 г.г. и до сих пор широко используются США и союзниками в модернизированных версиях.

«Фаланга» обеспечивает самостоятельный поиск, обнаружение, идентификацию, сопровождение и поражение воздушной цели (противокорабельной ракеты или самолета) огнём скорострельных мелкокалиберных пушек. Наземная версия «Фаланги» использовалась США в 2005 г. в Ираке. По сообщениям, 22 такие системы сбили более чем 100 воздушных целей (ракет, артиллерийских и минометных снарядов). Согласно одной американской армейской публикации, после того, как система обнаруживает угрозу, «оператор должен идентифицировать цель почти мгновенно, чтобы уничтожить воздушную цель вовремя, но он это не способен сделать». Поэтому функции обнаружения и поражения воздушных целей полностью возложены на автоматизированную систему.

Другие страны разработали похожие системы оборонительного оружия. Израиль развернул свою ракетную систему «Железный Купол» около границы с Сектором Газа и в Эйлате около Синайского полуострова. При помощи радара система обнаруживает и идентифицирует ракеты малой дальности и 155-миллиметровые артиллеристские снаряды на расстоянии до 70-ти километров. «Железный Купол» вооружен 20-ю ракетами-перехватчиками «Tamir». Израиль объявил , что у «Железного Купола» более чем 80-процентный показатель успешности поражения целей: «Она сбила множество ракет, которые убили бы израильские гражданские лица, так как это было в апреле 2011г.» В долю секунды после обнаружения поступающей угрозы «Железный Купол» показывает рекомендуемый ответ на угрозу оператору. Оператор должен немедленно решить, дать ли команду на поражение воздушной цели.

Другой пример системы оборонительного автоматического оружия – «Богомол NBS», Германия, предназначенной для защиты своих военных объектов в Афганистане. В течение 4.5 секунд после обнаружения целей на расстоянии примерно в 3 километра система открывает огонь из 6 35-миллиметровых автоматических пушек со скорострельностью в 1000 выстрелов в минуту. Система имеет «очень высокую степень автоматизации, включая автоматическое обнаружение и сопровождение целей. Эти процессы оператор может только наблюдать (источник информации не сообщает, может ли оператор прервать эти процессы). У данных систем оборонительного оружия уже есть существенная степень автономии, потому что они могут обнаруживать, сопровождать и поражать цели с минимальным человеческим участием. Но военные эксперты вообще подвергают сомнению эффективность и необходимость человеческого наблюдения и участия при использовании оборонительного оружия этого типа (для скоротечного ближнего боя). «Человек, конечно, участвует в принятии решения, но, главным образом, во время начального программирования робота. Во время эксплуатации системы, оператор действительно может только отвергнуть решение робота. Но это решение оператор должен принять за промежуток времени менее одной секунды. Когда оператор сталкивается с такой ситуацией, он склонен доверить принятие решения на поражение цели автоматике (несмотря на возражения, что система ненадежна, и т.п.).

Здесь отметим, что оборонительное автоматическое оружие против воздушных целей представляет не очень большую опасность для гражданских лиц, потому что оно разработано для того, чтобы уничтожить беспилотные воздушные цели, а не живую силу противника на поле боя.

2.2. Другие предшественники полностью автономного оружия

Другие «автоматизированные системы оружия, которые ещё сохраняют людей в «петле принятия решений», также являются потенциальными предшественниками полностью автономного оружия. Вооруженные силы некоторых стран уже развернули наземных военных роботов. Эти системы представляют значительно большую угрозу гражданским лицам, чем рассматриваемые ранее системы оборонительного автоматического оружия. У систем, которые будут обсуждаться ниже, мишенью является человек.

Южная Корея разработала и начала использовать сторожевых наземных роботов. В 2010 г. Южная Корея установила стационарных сторожевых роботов SGR-1 (ценой $ 200,000 каждый), вдоль демилитаризированной зоны для того, чтобы обнаруживать появление в демилитаризованной зоне людей. Роботы обнаруживают людей при помощи инфракрасных датчиков и датчиков движения и посылают предупредительный сигнал и изображение цели в центр управления.

Из центра управления оператор принимает решение, стрелять или нет по цели из 5.5-миллиметрового пулемета или 40-миллиметрового автоматического гранатомета. Датчики SGR-1 могут обнаруживать людей на расстоянии в 2 мили днём и на расстоянии в 1 милю ночью. Оружие робота может поражать цели на расстоянии в 2 мили. Сейчас у робота есть и автономные возможности наблюдения, но он не может стрелять без человеческой команды. Однако имеются сообщения (журнал Institute of Electrical and Electronics Engineers), что у этого робота есть автоматический режим, в котором он сам принимает решение о применении оружия. Правда, наверное, оператор может удалённо отключить автоматический режим работы робота…

Израиль тоже развернул сторожевые технические системы вдоль 60-километровой границы Израиля с Сектором Газа. Система обнаруживает движение объекта и посылает сигнал в удалённый центр управления. Оператор оценивает полученные данные и решает, стрелять ли в цель. У этой сторожевой системы на вооружении имеется крупнокалиберный (12.7 мм) пулемёт с дальностью поражения 1.5 км. Эту систему планируется вооружить ещё и бронебойными ракетами. Командир подразделения, где стоят на вооружении эти системы, дал понять, что «в начальных фазах развертывания, мы оказываемся перед необходимостью держать человека в «петле принятия решения». Он, таким образом, подразумевал, что человек не всегда будет принимать решения о применении оружия.

Израиль также развернул другую полуавтономную наземную систему «Guardium», которая, по сообщениям, используется для того, чтобы патрулировать границу Израиля с Сектором Газа. «Guardium» разработан для того, чтобы выполнять обычные для охраны границы задачи, такие как патрулирование границы по запрограммированному маршруту. Но система может самостоятельно реагировать на незапланированные события, в соответствии с рекомендациями, запрограммированными с учётом особенностей местности и доктрины безопасности. У «Guardium» может быть режим «автономного выполнения миссии».

Беспилотные самолеты, такие как американский «X-47B», имеют большую степень автономии, чем широко рекламируемые «дроны». Оператор миссии следит за самолётом, но активно не управляет им, как в настоящее время это делается для дронов. X-47B самостоятельно взлетает, выполняет запрограммированное задание и возвращается на базу после команды оператора миссии.

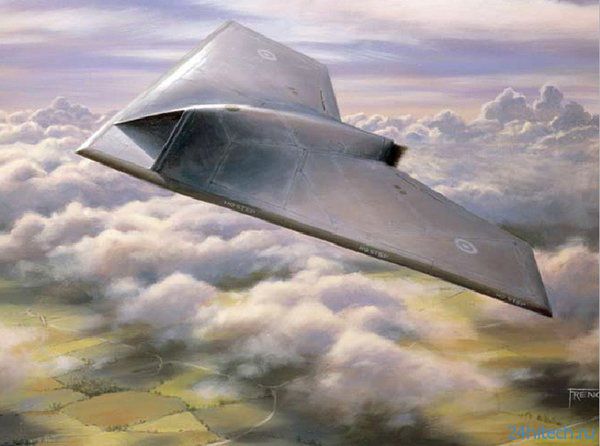

В 2010 г. Великобритания представила опытный образец своего боевого самолета «Taranis». Разработчики описали его как автономный и невидимый беспилотный самолет стратегической авиации. «Taranis», как ожидают, пока сохранит человека в петле принятия решения, но подразумевается возможности его большей автономии в будущем.

Другие страны также разрабатывают или выпускают беспилотные самолеты, которые являются предшественниками полностью автономного оружия. Израильская «Гарпия», например, была охарактеризована как «комбинация беспилотного самолёта и крылатой ракеты». Её задача – самостоятельно долететь до запрограммированной зоны патрулирования, найти там сигналы вражеских радаров и затем уничтожить цель (систему, на которой установлен радар).

Теперь расскажем о «роях». Американские вооруженные силы планируют массовое использование автономных самолетов большими группами («роями»). Самолёты сами распределяют между собой цели, а диспетчер управляет ими как единой группой, а не персонально каждым самолётом. В случае использования «роев», человеческое участие в работе системы минимальное, потому, что оператор физически не в состоянии отследить большое количество целей и очень быстро принять решение по каждой цели.

Поскольку люди все еще сохраняют контроль над решением использовать летальное оружие, вышеупомянутые системы оружия еще не полностью автономны, но они развиваются быстро в этом направлении. Сторонники полностью автономного оружия рекламируют его военные преимущества, такие как сокращение численности войск, требуемых для военных операций, высокой «бдительности» и мгновенной реакции часовых, не подверженных страху. Критики полностью автономного оружия, в первую очередь, беспокоятся о безопасности мирного населения в зоне военных действий.

3. Роботы-убийцы и международное гуманитарное право

Цивилизованное общество выработало законы и нормы гуманного ведения войны, юридически закреплённое в документах международного гуманитарного права. Существует оружие (в частности, химическое оружие и противопехотные мины), применение которого запрещено международным гуманитарным правом. И государства, подписавшие Конвекции о запрещении химического оружия и о запрещении противопехотных мин или уже уничтожили запасы такого оружия, либо приступили к его уничтожению.

А как обстоят дела с полностью автономным оружием?

Смогут ли роботы-убийцы выполнять требования международного гуманитарного права, минимизировать потери гражданского населения в зоне военного конфликта. Критики полностью автономного оружия приводят множество убедительных доводов, что это невозможно, а его сторонники предлагают различные способы, как сделать роботов-убийц гуманнее.

3.1. Доводы критиков против полностью автономного оружия

«Роботы-убийцы не смогут соблюдать международное гуманитарное право» – считают противники полностью автономного оружия.

Первоначальная оценка полностью автономного оружия показывает, что, похоже, роботы-убийцы будут неспособны соблюдать ключевые принципы международного гуманитарного права. Они будут неспособны следовать правилам гуманного ведения военных действий различение (противника и мирных жителей), пропорциональности (применения оружия) и военной необходимости (применения оружия). Даже убежденные сторонники полностью автономного оружия признают, что, проблема различения противника от гражданского лица является одной из нескольких «пугающих проблем».

3.1.1. Проблема различения

Правило различения (требует, чтобы солдат, перед тем как открыть огонь по цели, различил (определил) – это противник или мирный житель), является одним из самых больших препятствий для полностью автономного оружия. У полностью автономного оружия нет способности ощутить или интерпретировать различие между солдатами противника и гражданскими лицами, особенно в современной боевой окружающей обстановке.

Изменение характера вооруженного столкновения за прошлые несколько десятилетий (от войны между солдатами на поле боя – к асимметричным конфликтам), характеризуемым боями на городских улицах среди гражданского населения, сделали различение воюющих и невоюющих людей очень трудным. Государства, активно разрабатывающие автономное оружие (США, Израиль, европейские страны) воюют преимущественно с террористами, которые не носят униформы или знаков отличия. Вместо этого, они стремятся быть как можно более похожими на гражданское население. Казалось бы, что робот может легко дать ответ ДА или НЕТ на вопрос с двойным ответом — действительно ли человек является противником? Но, фактически, полностью автономное оружие не сможет дать правильный ответ, если воюющие стороны не будут носить форму и/или знаков отличия (например, погоны). Различение гражданского лица и вооруженного террориста находится вне рамках машинного восприятия. В любом случае, террористам было бы легко обмануть этих роботов, например, пряча оружие.

3.1.2. Проблема пропорциональности

Требование, чтобы применение оружия было пропорциональным (одно из самых сложных правил международного гуманитарного права) нуждается в человеческой оценке ситуации, что непосильно для полностью автономного оружия. Тест пропорциональности запрещает применение оружия, если ожидаемый вред гражданским лицам превышает ожидаемый эффект от его военного применения. Определение пропорциональности применения того или иного оружия зависит в большой степени от конкретной ситуации на поле боя. Юридически правильный ответ в одной ситуации может стать неверным даже при небольшом изменении фактов, лежащих в основе юридической оценки.

Очень маловероятно, что робот сможет анализировать огромное количество возможных сценариев, чтобы правильно интерпретировать ситуацию в режиме реального времени. Проблемы робота с анализом такого количества ситуаций из-за ограниченности вычислительной мощности компьютера и программного обеспечения вмешались бы в его способность правильно выполнить тест пропорциональности. Те, кто интерпретирует международное гуманитарное право в сложных и динамичных сценариях, призывают на помощь человеческое суждение, а не автоматическую способность принятия решения компьютером. Тест пропорциональности субъективен, учитывает довольно широкий спектр мнений и должен, прежде всего, быть вопросом здравого смысла и разума военных начальников.

Международные суды, вооруженные силы, например, приняли «стандарт разумного военноначальника». Международный уголовный трибунал для бывшей Югославии, например, писал: «В определении, было ли применение оружия пропорционально, необходимо исследовать, может ли в сложившейся ситуации человек в условиях, когда вокруг совершаются массовые преступления, ожидать, что чрезмерные жертвы среди гражданского населения будут результатом применения оружия по его приказу». Тест на пропорциональность требует больше, чем балансирование количественных данных. И робот не может быть запрограммирован так, чтобы дублировать психологические процессы при принятии человеком решения (которые необходимы, чтобы оценить пропорциональность применения оружия).

Приведём примеры.

Сценарий, в котором полностью автономный самолет идентифицирует появившуюся важную цель (например, лидера бандформирования), иллюстрирует трудности, с которыми такие роботы могут столкнуться при применении теста пропорциональности. Самолет может правильно определить местонахождение вражеского лидера в населенном районе, но он должен будет оценить, будет ли законно, стрелять в него. Во-первых, если такая цель находится в городе, то ситуация вокруг неё постоянно меняется. Например, школьный автобус может внезапно оказаться на линии прицеливания. Во-вторых, самолет должен взвесить ожидаемые преимущества уничтожения лидера против числа гражданских лиц, которые, как он ожидает, будут убиты. Каждый лидер может иметь различную ценность, и его ценность может изменяться в зависимости от ситуации в конфликте. Кроме того, люди лучше подходят для того, чтобы делать такие оценочные суждения.

3.1.3. Проблемы военной необходимости

Как и пропорциональность, военная необходимость требует субъективного анализа ситуации. Это позволяет вооруженным силам планировать военные действия, принимать во внимание практические требования военной ситуации в любой данный момент времени. Но военная необходимость ограничивается требованием «человечности». 1 ученый описал военную необходимость как «контекстно-зависимое, основанное на ценности суждение командующего (в пределах определенных ограничений достоверности)». Идентификация, стал ли вражеский солдат «вне боя» (по-французски hors de combat) т.е., не способный или не желающий оказать сопротивления, требует человеческой оценки. В частности, полностью автономному роботу-часовому будет трудно принять решение – стрелять ли ещё у упавшего нарушителя границы (в которого робот уже стрелял), или, может, следует в него выстрелить ещё.

3.1.4. Проблема отсутствия человеческих эмоций

Еще более серьезная проблема состоит в том, что полностью автономное оружие не обладает человеческими эмоциями (необходимыми для оценки намерений человека) которые является ключевыми для различения цели. Если невозможно предположить, что все люди вокруг являются противниками (т.е., целями), тогда необходимо выяснить, кто противник, а кто нет. 1 из способов определить, является ли человек противником, состоит в том, чтобы понять эмоциональное состояние человека. Но бывает огромное число обстоятельств, где применять оружие нет необходимости. Например, напуганная мать может бежать за своими 2 детьми и кричать на них, чтобы те прекратили играть с игрушечными пистолетами около (человека) солдата. Солдат может распознать страх матери, детскую игру и признать намерения детей безопасными. А полностью автономное оружие увидело бы, что к нему бегут 2 вооруженных человека и открыло бы по ним огонь.

Сторонники полностью автономного оружия предполагают, что отсутствие человеческих эмоций — главное его преимущество. Но они не рассматривают побочные эффекты применения такого оружия. Сторонники подчеркивают, например, что роботы неуязвимы для эмоциональных факторов, таковы как страх и гнев, которые могут «омрачить» рассудок и привести к атаке на гражданских лиц. Они также считают, что роботы могут быть запрограммированы так, чтобы действовать без страха за собственную «жизнь» и, поэтому, могут пожертвовать собой.

Человеческие эмоции, однако, обеспечивают 1 из лучших гарантий защиты против убийства гражданских лиц. И отсутствие эмоций может сделать убийство более лёгким. При обучении солдат (чтобы им было психологически проще уничтожать живую силу противника) им часто пытаются привить «психологию робота» когда то, что иначе казалось бы ужасным действием, может быть хладнокровно выполнено. Этот процесс уменьшения эмоциональной чувствительности может быть необходимым, чтобы помочь солдатам выполнять боевые операции и справляться с ужасами войны. Но, безотносительно военной подготовки, солдаты сохраняют способность своей эмоциональной идентификации с гражданскими лицами. Это — важная часть сочувствия, которое является главной в сострадании.

Роботы не могут идентифицировать себя с людьми, т.е., они неспособны испытывать сострадание (сильную проверку на готовность убить). Например, робот в зоне боевых действий мог бы выстрелить в ребенка, направляющего на него оружие. В отличие от робота, солдат-человек мог бы вспомнить своих детей, задержать открытие огня и найти более милосердное решение этой ситуации. Одно из самых больших ограничений для проявления жестокости во время войны всегда было естественное желание большинства людей не убивать. Этот естественный запрет так силён, что, многие умерли бы сами, чем убили бы кого-то. Снятие этого запрета на убийство при помощи использования роботов устранило бы самое сильное психологическое и этическое ограничение на применение оружия во время войны. Война стала бы негуманно эффективной и не была бы ограничена естественным желанием солдат не убивать.

С другой стороны, полностью автономное оружие может стать прекрасным инструментом репрессии для диктаторов, стремящихся сохранить власть. Даже наиболее преданные диктатору войска могут, в конечном счете, повернуть против него своё оружие, если диктатор отдаст приказ стрелять в собственный народ. Диктатор, который обратился к помощи полностью автономного оружия, не будет бояться, что его вооруженные силы взбунтуются. Роботы не идентифицируют себя с их жертвами и будут выполнять приказ независимо от того, насколько негуманный он был.

3.1.5. Проблема ответственности за убийство полностью автономным оружием

Учитывая, какие проблемы полностью автономное оружие создаёт международному гуманитарному праву и как оно игнорирует психологические основы гуманитарной защиты, неизбежно, что оно когда-нибудь убьёт или ранит множество беззащитных гражданских лиц. Когда появляются многочисленные жертвы среди гражданского населения в вооруженном столкновении, люди хотят знать, кто за это должен нести ответственность. Если бы убийство было совершено полностью автономным оружием, стал бы вопрос: кого считать за это ответственным? Варианты ответов включают военноначальника, программиста, изготовителя полностью автономного оружия и даже самого робота. Однако ни 1 из этих вариантов не является удовлетворительным. Поскольку нет никакого справедливого и эффективного способа назначить юридическую ответственность за противоправные действия, переданные полностью автономному оружию, подрывается ещё 1 инструмент защиты гражданских лиц во время вооружённых конфликтов.

1 способ решения проблемы может состоять в том, чтобы сделать военных начальников, которые используют такое оружие, ответственными за его действия на поле боя. Однако считается, что солдаты – достаточно автономные существа. И их командиры не несут юридической ответственности за противоправные действия своих подчиненных (за исключением очень особых обстоятельств). Поэтому, было бы несправедливым возложить всю ответственность на военноначальника за действия полностью автономного оружия. И, наверное, несправедливо считать людей ответственными за действия машин, над которыми они не имеют контроля. В некоторых ситуациях, (принцип несения «ответственности за команду») военноначальник может считаться ответственным за военные преступления, совершенные подчиненным. Этот принцип применяется, если военноначальник знал (или должен был знать), что его подчинённый запланировал совершить преступление. И военноначальник не принял меры, чтобы предотвратить преступление, или не наказывал преступника после совершения преступления.

В то время как этот принцип стремится обуздать нарушения международного гуманитарного права, усиливая ответственность военноначальника, он плохо подходит для полностью автономного оружия. С одной стороны, «ответственность за команду», вероятно, можно было бы применить, если бы командующий знал потенциальные способности этого оружия выполнять незаконные действия против гражданских лиц. И все же опрометчиво применил полностью автономное оружие.

С другой стороны, если бы военноначальник понял (как только робот начал действовать), что робот совершает преступление, то военноначальник был бы неспособен перепрограммировать робота в режиме реального времени, чтобы предотвратить преступление. Потому что робот разработан так, чтобы действовать полностью автономно. Кроме того (как будет обсуждено более подробно ниже), военноначальник не может эффективно наказать робота после того, как тот совершит преступление. Таким образом, кроме случаев опрометчивого поведения, «ответственность за команду» нельзя применять, и военноначальник не будет считаться ответственным за действия полностью автономного оружия.

Противоправное действие, совершённое полностью автономным оружием, может быть результатом недоработки программного обеспечения. Однако программист с полной уверенностью не может предсказать решение, которое полностью автономный робот примет на поле боя. Поэтому, считать программиста ответственным будет справедливо, если описанная выше ситуация произошла в результате небрежности со стороны команды программистов при написании компьютерной программы. Кроме того, чтобы считать программиста преступно ответственным в соответствии с международным гуманитарным правом, нужно доказать, что программист преднамеренно запрограммировал противоправное действие робота.

Некоторые эксперты отмечают возможность трактовать ответственность производителя за качество выпускаемой продукции как потенциальную модель для введения ответственности изготовителей полностью автономного оружия за его противоправные действия. Если бы изготовители могли бы считаться строго ответственными за недостатки в этом оружии, то ответственность изготовителей стала бы стимулом для производства очень надёжных полностью автономных систем вооружения. Однако режим ответственности за качество выпускаемой оружейной продукции тоже противоречит верному решению, потому что производители оружия, как правило, не наказываются за то, как их оружие в дальнейшем используется.

К сожалению, возложение ответственности на любого из описанных выше действующих лиц (военноначальника, программиста, изготовителя) не удержит самого робота от противоправных действий. По определению, полностью автономное оружие работает без человеческого контроля и возможности вмешательства в его работу. А отсутствие эмоций у полностью автономного оружия не позволит ему испытать раскаяние — если кто-то вместо самого робота будет наказан за его действия.

Так же есть мнение, что само полностью автономное оружие могло бы считаться ответственным за незаконное убийство гражданских лиц. Однако, в ближайшие 10-20 лет это невозможно сделать из-за недостаточного уровня развития робототехники. Робота можно «наказать», уничтожить его или ограничить его программное обеспечение. Однако, это вряд ли удовлетворит жертв робота, ищущих возмездия. Кроме того, если робот не понимает, что будет наказан за то, что нарушил закон, его решения не будут находиться под влиянием угрозы ответственности.

3.1.6. Проблема понижения порога принятия решения о начале войны

Достижения в военной технологии позволили вооруженным силам значительно уменьшить непосредственное человеческое участие в ведении военных действий. Изобретение беспилотных летательных аппаратов (дронов) позволило США проводить военные операции в Афганистане, Пакистане, Йемене, Ливии, без страха перед человеческими жертвами со своей стороны. Из-за этого фактора, постепенная замена людей на полностью автономное оружие может сделать принятие решения начать войну более лёгким, а бремя потерь в зоне военного конфликта перейдёт к гражданским лицам. Автоматизированное оружие изменяет политические расчёты при ведении войны. Потенциальная угроза жизням гражданских лиц вражеского государства может быть обесценена или даже проигнорирована при принятии решения об использовании военной силы. Результат применения вооружённых дронов показывает, к чему может привести применение оружия с еще большей автономией.

Военные эксперты утверждают, что беспилотные самолеты уже понизили порог для принятия решения о начале войны, облегчили политическим лидерам принятие решения на применение военной силы. Кроме того, быстрое увеличение количества беспилотных систем может притупить инстинктивные чувство неприятия убийства. Беспилотные системы создают физическое и эмоциональное «расстояние» от поля боя и, поэтому, делает убийство более лёгким.

Действительно, некоторые операторы дронов сравнивают атаки дрона с компьютерной игрой. Поэтому, они чувствуют себя эмоционально отделенными от акта убийства. Война становится более безопасной и лёгкой, когда солдаты удалены от ужасов войны и рассматривают врага не как людей, а как человеческие фигурки на экране. И есть очень реальная опасность потерять средство устрашения, которое обеспечивают ужасы войны. Полностью автономное оружие создаёт те же самые проблемы.

В то время как некоторые достижения в военной технологии способствуют предотвращению войны (например, ракетно-ядерное оружие), разработка полностью автономного оружия сделает войну более вероятной и приведёт к непропорциональным потерям среди мирных жителей. Поэтому, полностью автономное оружие никогда не должно появиться в арсеналах вооруженных сил.

3.2. Доводы сторонников полностью автономного оружия

Сторонники полностью автономного оружия признали, что такие новые роботы должны были бы выполнить международное гуманитарное право. Поэтому предложили множество механизмов соблюдения гуманитарного права, которые, по мнению сторонников полностью автономного оружия смогут предотвратить любые нарушения законов войны. 2 из этих предложения будут обсуждены ниже.

3.2.1. «Нравственный регулятор» робототехника Рональда Аркина

Рональд Аркин (Ronald Arkin), робототехник из Технологического института штата Джорджия, сформулировал «самую всестороннюю архитектуру» для механизма соблюдения международного права при использовании полностью автономного оружия. Применение оружия должно быть ограничено минимально необходимым уровнем LOW (закон войны law of war) и правилами использования летального оружия в бою ROE (rules of engagement) прежде, чем оно сможет использоваться автономной системой. Он утверждает, что такие ограничения могут быть достигнуты при помощи так называемого «нравственного регулятора» (ethical governor).

Нравственный регулятор — сложное предложение, которое требует, чтобы роботы перед открытием огня использовали двухступенчатый процесс оценки ситуации. Во-первых, робот должен оценить информацию, которую он получил при помощи своих систем, и определить, запрещено или нет применение оружия в соответствии с международным гуманитарным правом и указанным выше правилам. Если нарушается требование различия (робот должен отличать живую силу противника от гражданских лиц), применение оружия блокируется. Если это требование не нарушается, подготовка к применению оружия может продолжаться, если атака цели необходима согласно оперативному приказу.

На втором шаге, робот должен оценить последствия применения оружия, пользуясь тестом пропорциональности. Нравственный регулятор количественно определяет множество критериев, таких как вероятность эффективного поражения цели в военном отношении, возможность поражения гражданских лиц или гражданских объектов, основанных на технических данных.

Затем робот использует алгоритм, который объединяет статистические данные с поступающей информацией, чтобы прагматически оценить необходимость применения оружия. Робот может начать стрелять, только тогда, когда он находит, что применение оружия удовлетворяет всем этическим ограничениям и минимизирует сопутствующий ущерб относительно военной необходимости уничтожения цели.

Аркин утверждает, что с нравственным регулятором полностью автономное оружие было бы в состоянии выполнить международное гуманитарное право лучше, чем люди. Например, оно могло бы получать больше информации и обработать ее быстрее, чем люди. Робот не может применить оружие под влиянием гнева или страха. Робот мог бы контролировать этическое поведение своих человеческих коллег-солдат. В то же время оптимистичный Аркин признает, что ещё преждевременно определять, возможна ли реализация этого механизма в полностью автономном оружии.

3.2.2. «Cильный» искусственный интеллект

Другой, еще более амбициозный подход: автономные роботы будут соблюдать гуманитарные законы, потому что будут иметь разум, сравнимый (а, может, и превышающий) человеческий разум. Министерство обороны США определяет роботов с «сильным (истинным) искусственным интеллектом» как роботов с «подобной или большей способностью думать как человек». Защитники концепции разработки автоматизированного оружия с «сильным» искусственным интеллектом, считают, что использование роботов, управляемых «сильным» искусственным интеллектом на поле битвы приведёт к меньшему количеству разрушений, станет «воспитывающей силой» во время войны и поможет цивилизации в ее борьбе против терроризма.

У таких роботов «вычислительная мощность компьютера приблизится к познавательной способности человеческого мозга». Но многие эксперты полагают, что это предложение быть больше желаемо, чем реализуемым в действительности. Даже если бы разработка полностью автономного оружия с подобным человеку разумом стала бы возможной, у роботов отсутствовали бы некоторые человеческие качества, такие как сострадание и способность понять людей.

4. Контроль за разработками полностью автономного оружия

Согласно Статье 36 Дополнительного Протокола I к Женевской конвенции, государства должны разрабатывать новое и модернизировать существующее оружие в соответствии с международным правом. Системы автоматизированных вооружений даже с участием человека в процессе управления должны подвергаться международному контролю.

Международный комитет Красного Креста выдвинул на 1 план автономное оружие как проблемную область. Относительно Статьи 36. Международный комитет написал: «Использование оружия дистанционного управления на больших расстояниях, или оружия, с датчиками обнаружения живых целей приводит к автоматизации поля битвы, в котором солдат играет все менее важную роль. И страшно подумать, что может случиться, если полностью автономное оружие будет действовать только по своему усмотрению. Ведь в самой совершенной компьютерной программе может быть сбой. Контроль необходим ещё потому, что любую «не опасную» беспилотную систему легко вооружить, как это произошло с американским дроном Predator.

Чтобы соответствовать международному гуманитарному праву, полностью автономное оружие нуждалось бы в человеческих качествах, в которых оно «врождённо» испытывает недостаток. В частности у таких роботов не было бы способности почувствовать и понять намерения людей. Кроме того, многих людей мысль о роботах, принимающих жизненно важные решения, находящихся ранее в компетенции людей, приводят в ужас. Развитие автономного оружия должно быть остановлено прежде, чем оно достигнет этапа, когда люди будут полностью удалены из цепочки принятия решений.

Заключение

Полностью автономное оружие сделает развязывание военных действий легче и значительно увеличит урон гражданским лицам во время военных действий. Оно неспособно выполнять основные принципы международного гуманитарного права. Оно подрывает другие, неюридические гарантии, которые защищают гражданские лица во время военных действий. Хотя полностью автономного оружия еще не существует, военная технология быстро развивается в этом направлении. И появление полностью автономного оружия (роботов-убийц) возможно в течение ближайших десятилетий.

Поэтому, прежде чем это станет свершившимся фактом, государства и ученые должны принять срочные меры, чтобы рассмотреть и отрегулировать развитие военной технологии, связанной с автономией роботов. В частности государства должны запретить создание оружия, у которого есть полная автономия, которое само будет решать, когда применить оружие.

Авторы доклада рекомендуют:

Всем государствам:

• Запретить разработку, производство и использование полностью автономного оружия через международный всеми признанный юридический документ.

• Принять внутригосударственные законы, запрещающие разработку, производство и использование полностью автономного оружия.

• Начать мониторинг технологий, которые могут привести к полностью автономному оружию. Мониторинг должен иметь место в самом начале процесса разработки и продолжаться по фазам разработки и тестирования автоматизированного оружия и оружия с частичной автономией.

Робототехникам и другим лицам, вовлеченным в разработку автоматизированного оружия

• Установить профессиональные нормы поведения, управляющие научными исследованиями в области автономного оружия.

Такие нормы поведения могут помочь гарантировать, что научные исследования в области автономного оружия развиваются в соответствии с международным гуманитарным правом, которое защищают гражданские лица в вооруженном конфликте. Академические и научные ассоциации могли бы спроектировать и распространить такой кодекс норм поведения. Нормы поведения для военного технического прогресса уже существуют в областях синтетической биологии и нанотехнологии.

Нет комментарий